ビジネス

Apple オープンソースの言語モデル「OpenELM」を発表 iPhone上での効率的なAI処理が可能

Appleは2024年4月24日、オープンソースの新しいAI言語モデル「OpenELM」を[公開]{target=“_blank”}した。(ELM:Efficient Language Model) このモデルは、効率的なパラメータ割り当てを実現するためにレイヤーごとのスケーリング戦略を採用しており、特定の層により多くの計算資源を割り当てることで全体の性能を向上させているという。 OpenELMは、2億7000万、4億5000万、11億、30億の4つの異なるパラメータ数を持つモデルバリエーションで提供される。 下図は、OpenELMの約11億パラメータモデルでそのパフォーマンスを評価した結果を表す。OLMo(Open Language Model)という言語モデルと比較して、事前トレーニングに必要なトークン数を半分に削減しつつ、パフォーマンスでは約2.36%の向上を達成しており、モデルの効率性と効果性を示しているという。 ![apple_open-elm_evaluation_frameworks1.jpg] :::small 画像の出典:[OpenELM]{target=“_blank”} ::: これまでの一般的な慣行とは異なり、OpenELMのリリースには、モデルの重みや推論コードだけでなく、公開データセット上でのトレーニングと評価のための完全なフレームワーク(トレーニングログ、複数のチェックポイント、事前トレーニングの設定などを含む)が含まれる。 さらに、Appleデバイス上での推論とファインチューニング用に、モデルをMLXライブラリに変換するコードも公開されているという。これによりAppleデバイス上での効率的なAI処理が可能となる。[同社が2023年12月に発表]{target=“_blank”}した「MLX」とは、Appleのチップ上で動作し、開発者が機械学習アルゴリズムの開発や実装を容易にするためのライブラリやツールを提供するフレームワークだ。 OpenELMのソースコード、事前トレーニングされたモデルの重み、およびトレーニングのレシピはオンラインで公開されており、Hugging Faceプラットフォーム上でもモデルは利用可能。 この包括的なリリースは、研究の透明性を高め、データやモデルのバイアス、潜在的なリスクについての調査を容易にすることで、信頼性のある結果を保証することを目的としているという。 :::box [関連記事:AIの遅れ取り返せるか Appleが開発者向けフレームワーク「MXL」Geminiの裏でひっそりと公開] ::: :::box [関連記事:AppleがスマートフォンのUI画面を認識できるマルチモーダルLLM「Ferret-UI」に関する論文を発表] ::: :::box [関連記事:Apple 次世代Siriか?音声アシスタントが画面上のコンテキストを「見て」理解できるAI「ReALM」を発表] ::: :::box [関連記事:Hugging Face(ハギングフェイス)とは|AI特化版GitHubを手がける成長企業 概要と使い方を解説] :::

Microsoftが新たな小規模言語モデル「Phi-3」を発表 ― 「Tiny but Mighty」―オフラインでも動作するモデルがアプリケーション開発を強力に支援

日本経済新聞が「NIKKEI Language Model」の開発を発表 40年分の記事情報で磨かれた経済情報特化型大規模言語モデル

イーロン・マスク氏「テスラは今年1.5兆円を自動運転のためのAI開発へ投資する」と発言

大日本印刷が音声をリアルタイムで文字に変換する「DNP対話支援システム」提供開始 気持ちや情報のポイントをフォントや色・大きさに反映

リコーがLLM開発に続きドイツの新興企業「ナティフAI」の買収を発表 更なるオフィス業務効率向上を目指す

NEC、高速・高性能な大規模言語モデル「cotomi Pro」と「cotomi Light」を開発

Forebesが選ぶ「2024年の注目すべきAI関連企業50社」発表 シリコンバレーの投資家を動かす合計347億ドル調達の企業リストとは

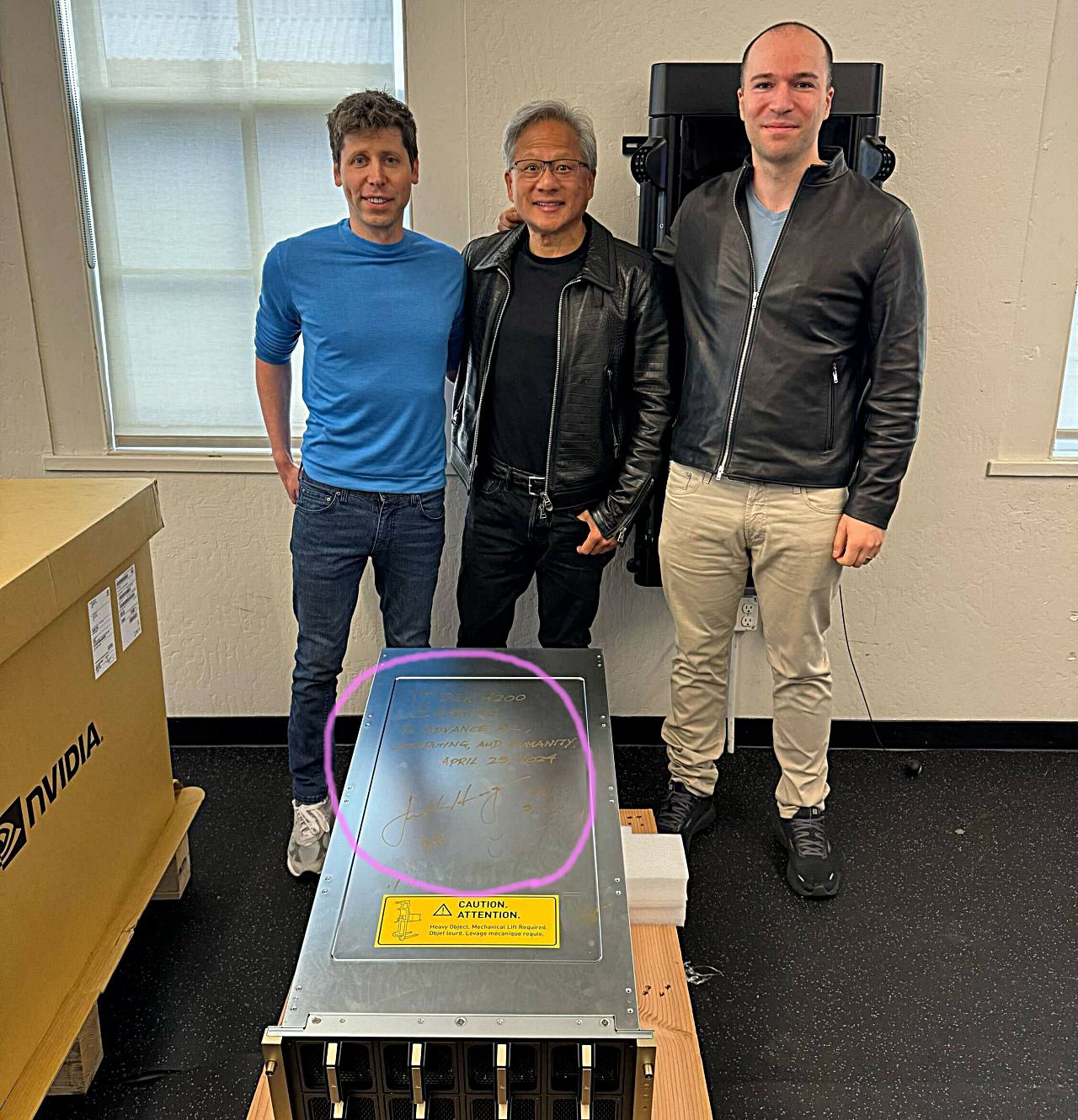

NVIDIAのCEO、Jensen HuangがOpenAIに最新GPU「H200」を直接お届け

なぜデル・テクノロジーズが選ばれるのか - 国内外の事例から同社の強みを紐解く

MetaがLLMに続きMRヘッドセット用OS「Meta Horizon OS」もオープンに ASUS・Lenovoなどが連携し、各社独自のMRヘッドセットを開発開始

米PagerDuty「生成AIの安全性と倫理への懸念が大企業の導入を遅らせる」Fortune 1000企業幹部の調査結果を公表

デル・テクノロジーズが提供する生成AI基盤設計のためのデザインガイド「Dell Validated Design for Generative AI」とは